介绍

大型语言模型 (LLM) 的出现极大地扩展了 AI 系统的界面和范围。然而,在 LLM 生成的流畅自然语言背后,仍然存在根本性的局限性。 关键在于 LLM 擅长语言模式,但本质上在语义和逻辑方面较弱。

为了解决这个局限性,本体的概念再次受到关注。 在本文中,我们将系统地回答以下问题:

- 什么是本体,它在 AI 中扮演什么角色?

- 本体与知识图谱有什么不同?

- 图 RAG 可以取代本体吗?

- 在基于 LLM 的服务中,本体实际上应该位于何处?

1. 什么是本体:一种“意义的层次结构”,而不仅仅是数据

本体是一种语义模型,它显式地定义了特定领域中使用的概念、关系和规则。 它不仅仅存储数据或定义结构;它规定了*“如何理解这个世界”。*

例如,在医学领域,本体定义了如下事实:

Doctor ⊆ Persontreats关系的主语必须具有Doctor类型。Hospital是一个Organization,而不是Person。

这些定义对人类来说是常识,但对于 AI 系统来说,它们是除非明确说明,否则永远无法知道的规则。

2. 为什么本体在 AI 中很重要

2.1 基于语义的推理

本体使 AI 能够逻辑地推断出未明确说明的事实。

例如,假设给出以下内容:

- A treats B.

treats的域是Doctor。

通过基于本体的推理,系统可以自动推断出:

A 是 Doctor。 A 是 Person。

这种推理对于传统的机器学习或单独的 LLM 来说是不可能的。

2.2 一致性验证和错误检测

LLM 经常生成看似合理但不正确的陈述(幻觉)。 本体作为一种机制来结构性地阻止这种情况。

例子:

- “护士进行手术。” → 违反本体规则 → 立即判断为错误。

在无法容忍错误的领域,例如医学、法律和金融,这是一个决定性的差异。

2.3 可解释的 AI(可解释性)

使用本体和知识图谱,我们可以解释 AI 判断的逻辑路径: “为什么得出这个结论?”

这超越了简单的用户信任,并且与监管、审计和问责制问题直接相关。

3. 本体 vs. 知识图谱:蓝图和建筑物之间的关系

本体和知识图谱经常互换使用,但它们的角色明显不同。

| 类别 | 本体 | 知识图谱 |

|---|---|---|

| 核心角色 | 概念、含义、规则的定义 | 实际的事实和实例 |

| 性质 | 抽象、稳定 | 具体、动态 |

| 例子 | “医生是人” | “李医生是医生” |

用一个类比:

- 本体是法律或蓝图的代码。

- 知识图谱是判例法或实际的建筑物。

没有本体,知识图谱仅仅是连接的数据, 而本体只有通过知识图谱才能连接到现实。

4. LLM 时代的标准架构:本体适合在哪里?

现代 AI 服务中最稳定的结构是如下所示的混合架构:

此结构中的核心原则很明确:

- LLM 是语言界面。

- 本体是思想体系。

- 知识图谱是记忆。

- 推理器是逻辑引擎。

LLM 不做判断;本体思考。

5. 图 RAG 可以取代本体吗?

首先说明结论:

图 RAG 可以“利用”本体,但不能“取代”它们。

5.1 图 RAG 的优势

- 基于实体和关系搜索

- 使用概念模式进行查询扩展

- 探索相关文档和节点

在这些领域,图 RAG 可以执行轻量级本体的部分角色。

5.2 图 RAG 的局限性

然而,图 RAG 本质上不提供:

- 基于形式逻辑的自动推理

- 一致性检查

- 规则违反检测

换句话说,图 RAG 可以“按照含义导航”,但不能“判断含义在逻辑上是否正确”。

5.3 现实的最佳解决方案

实践中最常采用的结构是:

更多文章

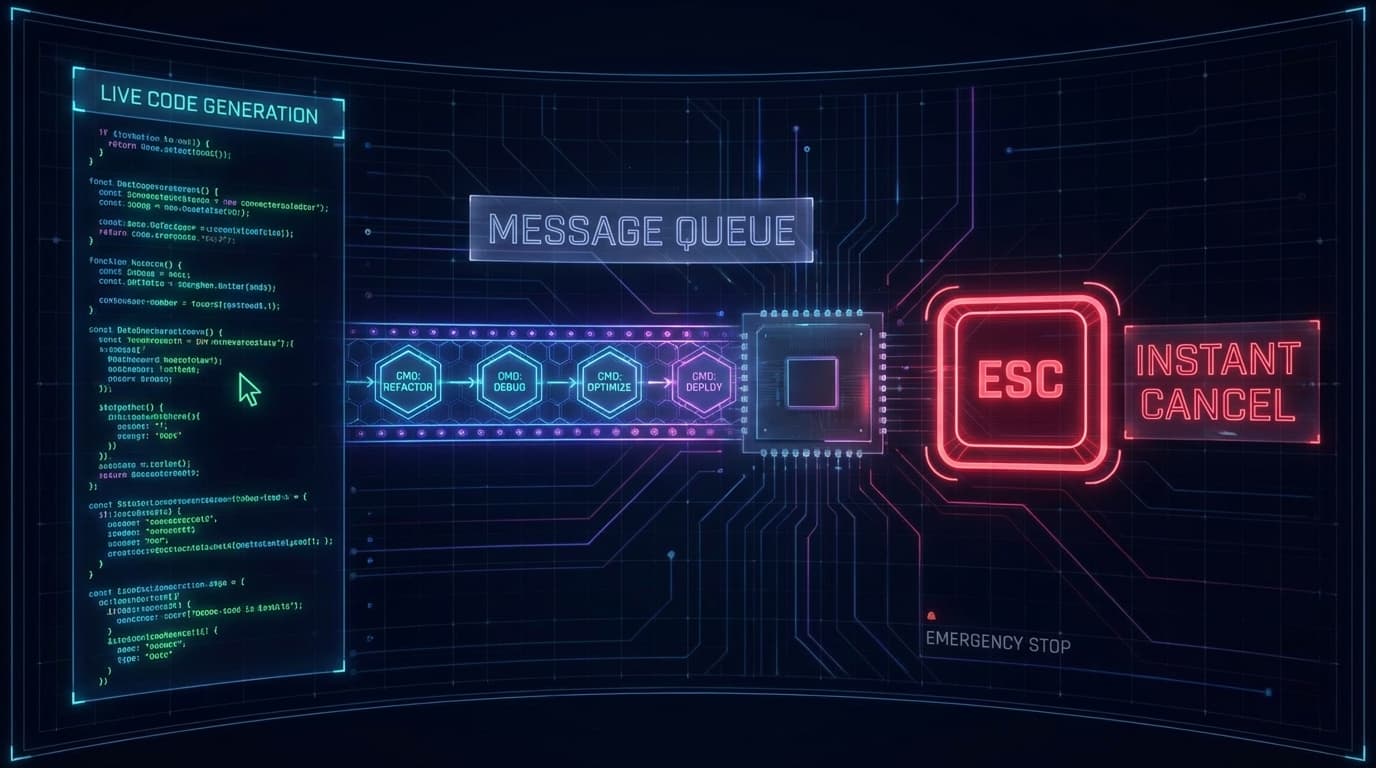

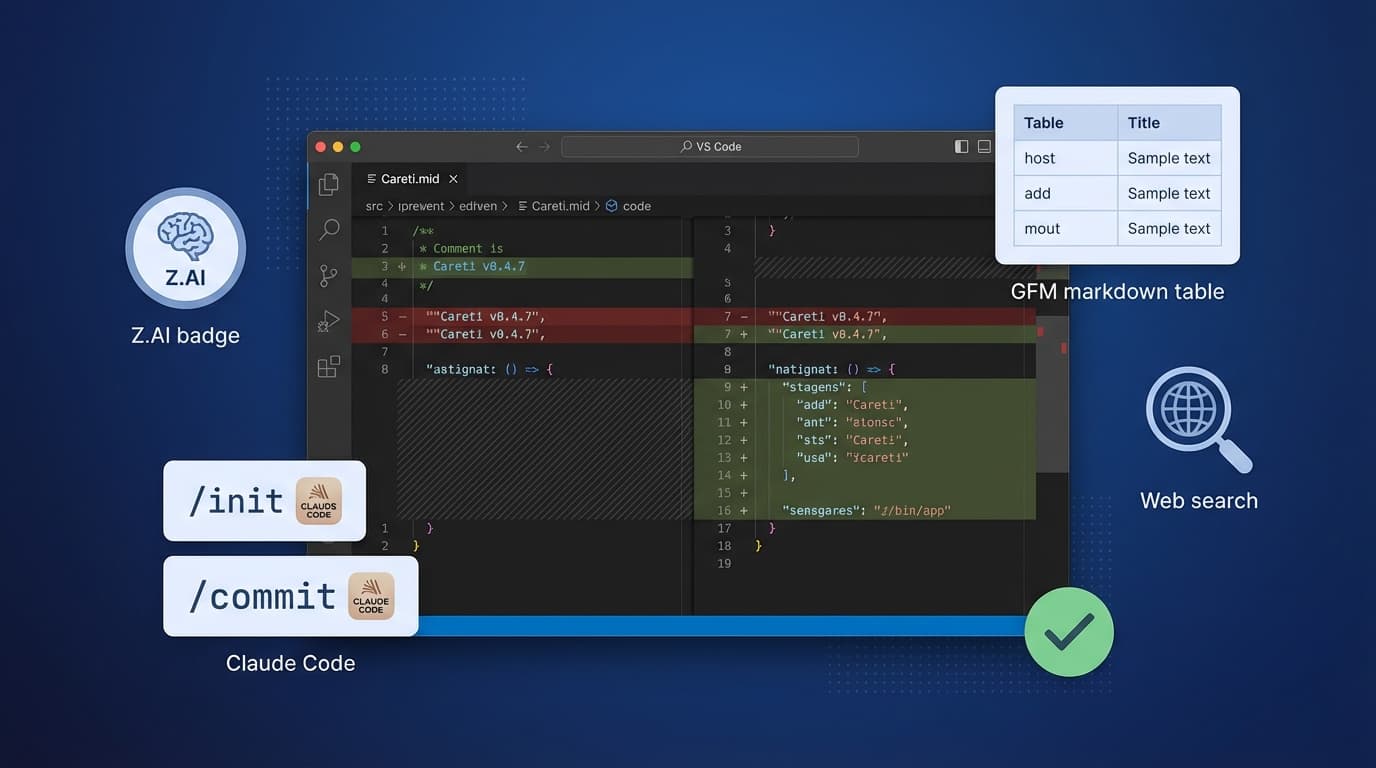

Type next instructions while AI is streaming, cancel with a single ESC press. Also includes Gemini 3.1 Pro Support, Direct VSIX Download, CLI sub-agent execution, and v0.4.7 infinite loading fix.

Careti v0.4.7添加了Z.AI GLM-4.7模型、Claude Code兼容命令系统、SmartEditEngine改进和UI增强。