2 янв. 2026 г.Luke

Caret NotebookLM: Будущее Суверенного ИИ и Открытого Исходного Кода в Свете Обвинений Solar 100B

В рамках технической дискуссии вокруг модели Solar 100B от Upstage мы исследуем путь к истинному суверенному ИИ и важность открытой проверки исходного кода с точки зрения Caret, как надежного ИИ-компаньона.

Недавно корейское ИИ-сообщество было взбудоражено техническими дискуссиями вокруг модели Solar 100B от Upstage. После появления заявлений о том, что модель была получена из китайской модели с открытым исходным кодом, важность технической проверки стала более заметной, чем когда-либо.

Этот спор выходит за рамки модели одной компании, ставя перед всеми нами важный вопрос: что представляет собой истинный 'Sovereign AI', и почему так важен здоровый союз с глобальной экосистемой открытого исходного кода? Обещание Upstage предоставить прозрачный ответ и добровольное участие сообщества открыли форум для здоровых технических дебатов, способствуя коллективному росту отечественной ИИ-экосистемы.

Чтобы глубже изучить эту тему, мы в Caret создали два видеоролика с использованием Caret Notebook LM.

- Обзор:

- Обсуждение:

Оба видео были созданы с использованием нашего проекта с открытым исходным кодом NotebookLM to YouTube. Мы продолжим делиться соответствующими новостями через блог Caret.

Взгляд Caret: Навстречу Надежному ИИ-Компаньону

Конечно, сложно напрямую сравнивать компанию, создающую огромные модели, такие как Upstage, со стартапом, как наш, который только делает свои первые шаги. Честно говоря, может даже показаться, что мы просто пытаемся вскочить на подножку этой острой проблемы. 😅

Однако, как создатели «ИИ-компаньона» и как разработчики, которые ежедневно используют ИИ, эта дискуссия отзывается в нас на другом уровне. Это служит ярким примером того, насколько важны «доверие» и «прозрачность» для развития ИИ-технологий, особенно Sovereign AI, и как процесс публичной проверки через сообщество может способствовать созданию здоровой технологической экосистемы.

Именно поэтому мы в Caret мечтаем о создании «совместно развивающегося ИИ-компаньона» на основе проверенного стабильностью открытого исходного кода Cline. Чтобы ИИ стал ближайшим коллегой разработчика, он должен, прежде всего, быть надежным. Это доверие может быть укреплено только посредством прозрачного процесса раскрытия исходного кода, развития вместе с сообществом и прохождения непрерывной проверки.

Мы надеемся, что эта дискуссия выйдет за рамки непродуктивных споров и, подобно приверженности Upstage публичной проверке, станет для всей отечественной ИИ-экосистемы возможностью подтвердить ценности прозрачности и открытости и расти вместе. Как член сообщества открытого исходного кода, Caret также будет стремиться к созданию инструментов и культуры, которые способствуют созданию здоровой технологической экосистемы.

[Обзор после трансляции] Как «Логи» Превратили Все Обвинения в Доказательства

Благодаря технической проверочной трансляции Upstage все предыдущие обвинения были подкреплены четкими данными и логами. Вы можете посмотреть полную трансляцию по оригинальной ссылке.

Как разработчик, вот краткое изложение ключевых доказательств, представленных в трансляции, объясняющее, почему они были решающими и как первоначальная критика возникла из-за технического недопонимания.

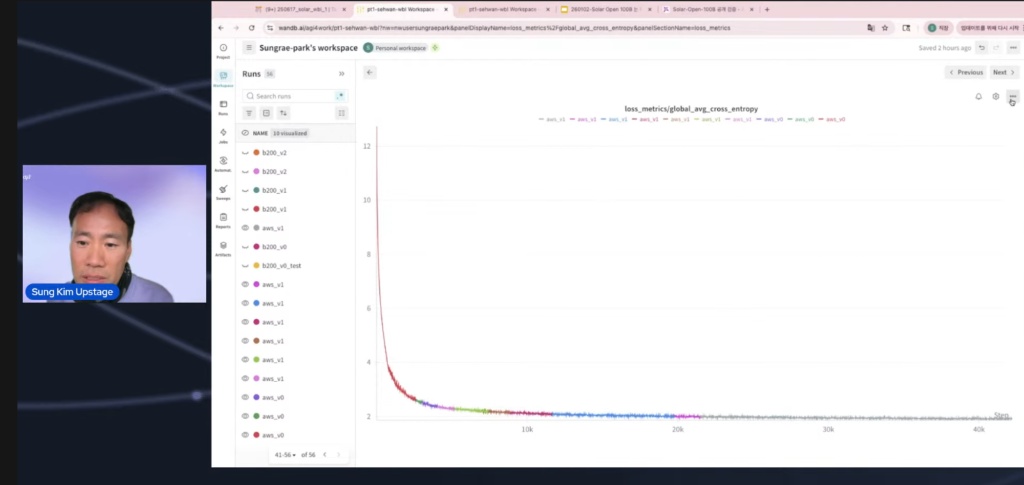

- Решающее Доказательство: Графики Журнала Обучения WandB Подтверждают «С Нуля» Самым убедительным доказательством был «график журнала обучения WandB», который записывал и визуализировал весь процесс обучения модели. Общедоступный график четко показал кривую, где значение Loss начиналось с 12 с самой первой контрольной точки, а затем резко падало.

Что это значит: Если бы они выполняли дообучение путем импорта контрольной точки из предварительно обученной модели, начальные потери не могли бы быть такими высокими (обычно они начинаются примерно с 2-3).

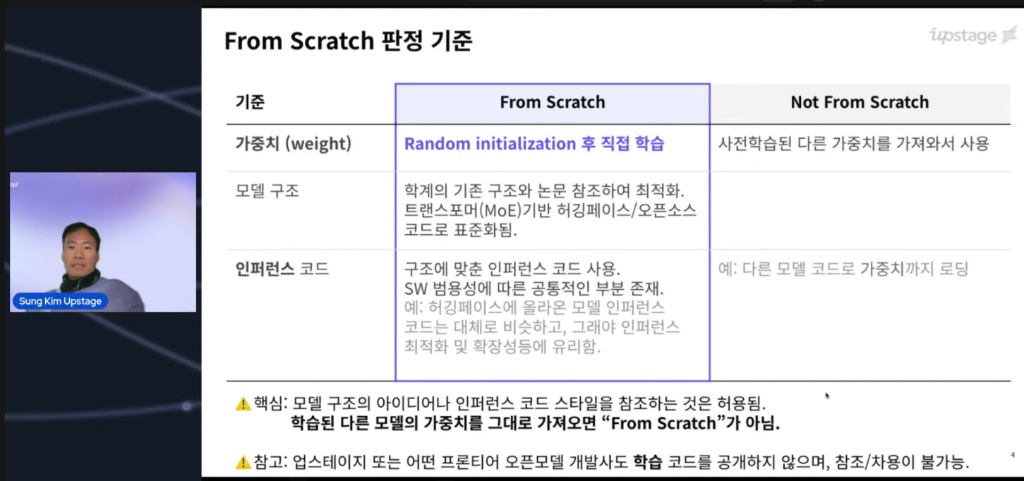

Сутью спора было определение «С Нуля». Поскольку многие были сбиты с толку этим стандартом, трансляция началась с его разъяснения. Было ясно дано понять, что начало обучения с чистого листа неизбежно приводит к очень высокому начальному значению потерь.

В качестве доказательства они показали скриншот панели управления WandB, на котором был записан фактический процесс обучения. На изображении ниже показано, что начальное значение Loss начинается очень высоко, что является веским физическим доказательством того, что модель начала обучение с чистого листа.

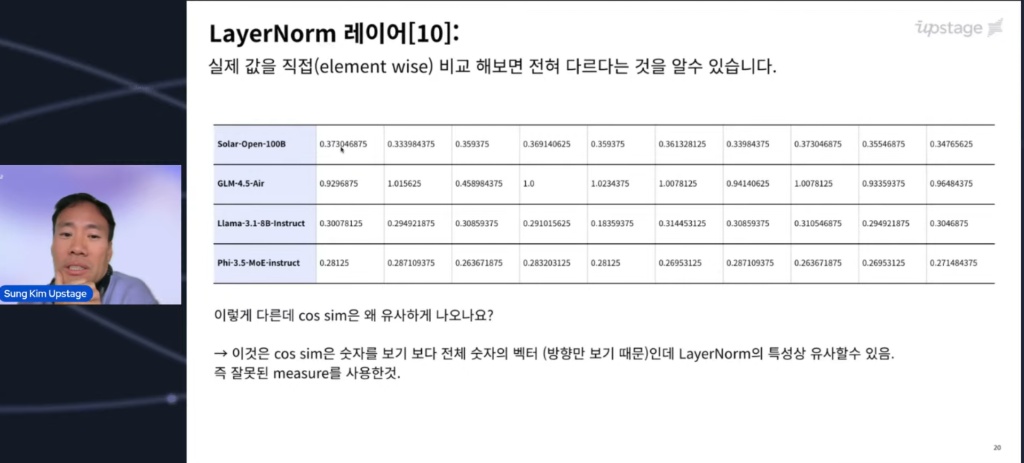

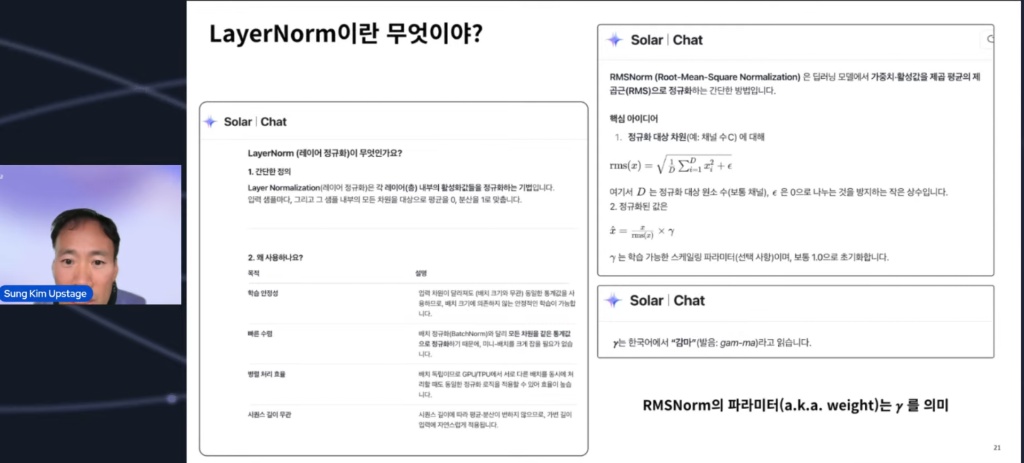

- Ловушка «Сходства»: Смотрим на Направление, а Не на Величину Также было продемонстрировано, почему «Косинусное Сходство», отправная точка обвинений, было ошибочной метрикой.

Ограничение метрики: Косинусное сходство учитывает только «направление» векторов. Если используется одна и та же архитектура (чертеж), направления векторов обязательно будут похожими из-за структурных характеристик слоев.

Фактическое сравнение: При изучении весов поэлементно масштаб и конкретные числовые значения были совершенно разными. Это подтвердило тот факт, что «то, что все они указывают на Полярную звезду, не означает, что это одинаковые фонарики».

(В качестве забавного примечания, изображения ниже содержат фрагмент разговора Upstage в то время, как маленькое «пасхальное яйцо». 😅)

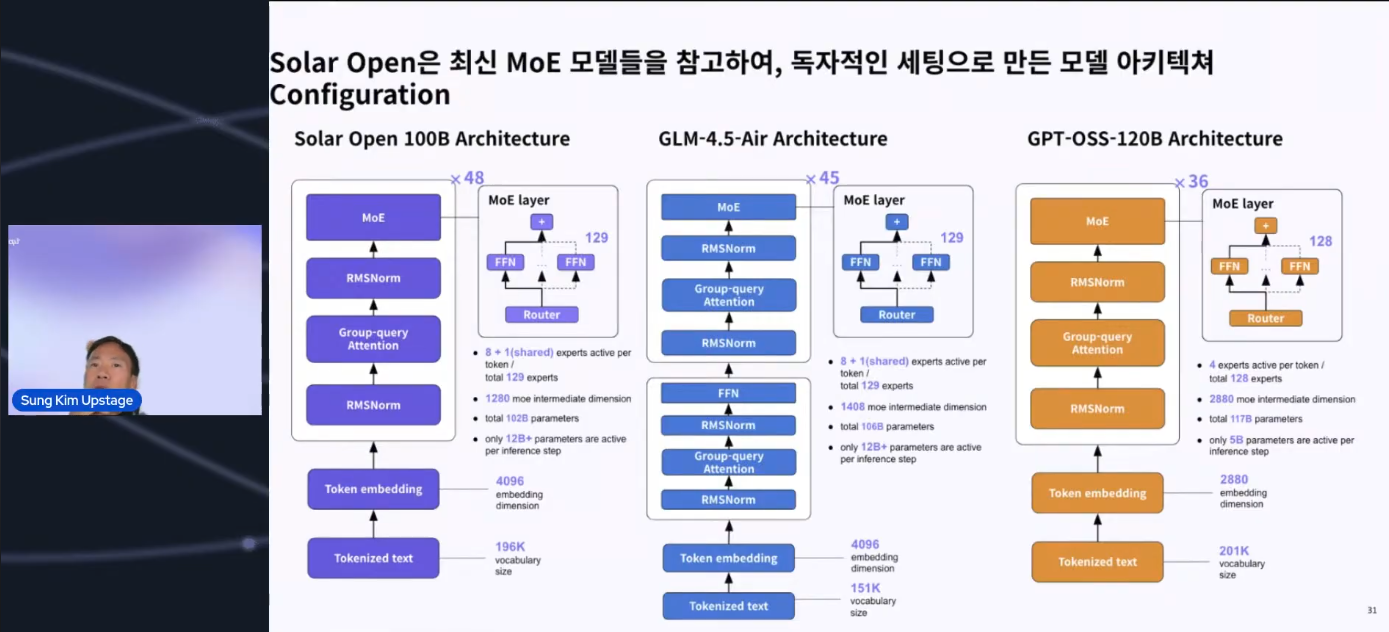

- Структурная Дифференциация: «Улучшение», а Не Копия

Структурные особенности также были четко объяснены, показывая, что это не была простая копия.

Отличия от GPT-OSS 120B: Структура была усилена путем добавления Shared Layers для стабильного обучения.

Отличия от GPT-OSS 120B: Структура была усилена путем добавления Shared Layers для стабильного обучения.

Отличия от GLM: Было подтверждено, что были приняты независимые инженерные решения и оптимизации, такие как смелое удаление Dense Layers, которые, как считается, мало влияют на производительность.

Вывод Это разъяснение придало большое доверие сообществу разработчиков, потому что оно было доказано не эмоциональными призывами, а данными, логами и архитектурой. В конце концов, это был момент, который подтвердил истину о том, что «код не лжет».

Другие статьи

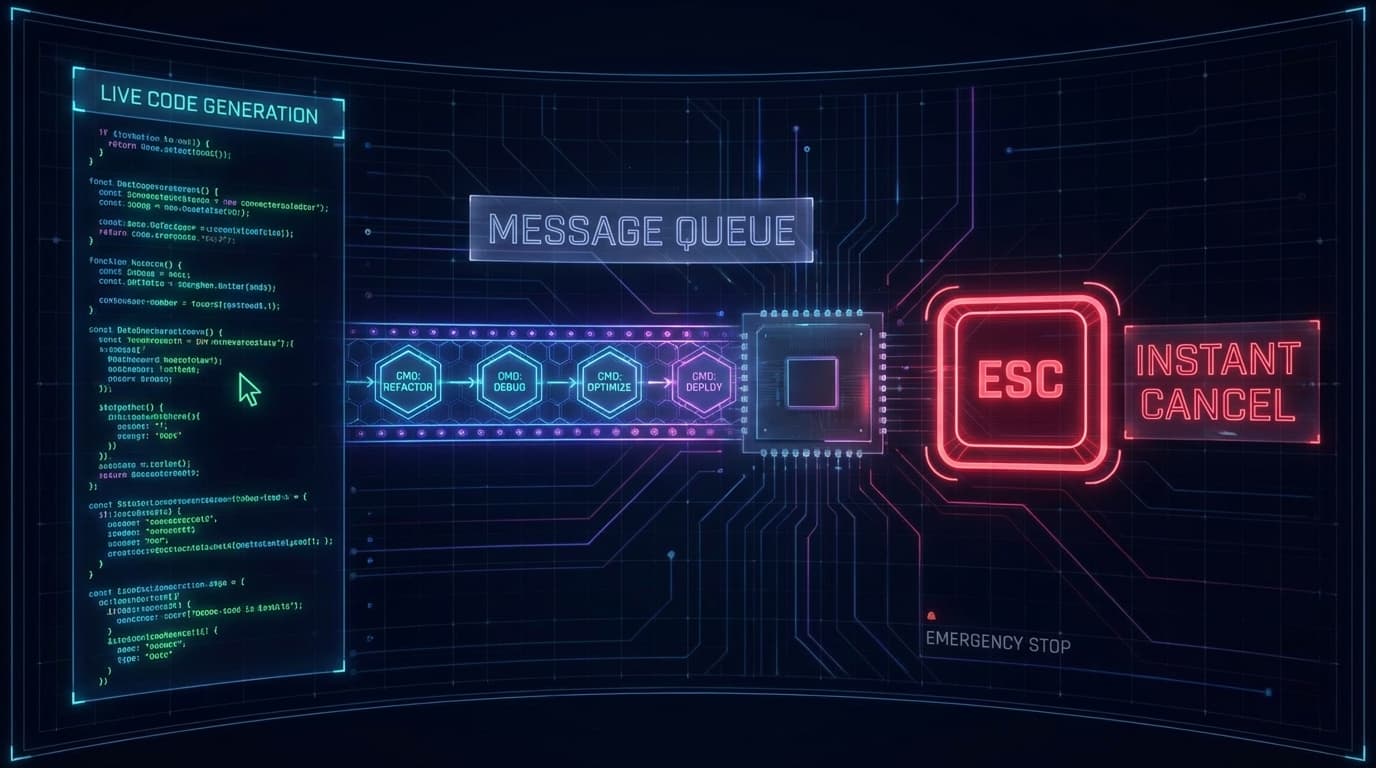

Type next instructions while AI is streaming, cancel with a single ESC press. Also includes Gemini 3.1 Pro Support, Direct VSIX Download, CLI sub-agent execution, and v0.4.7 infinite loading fix.

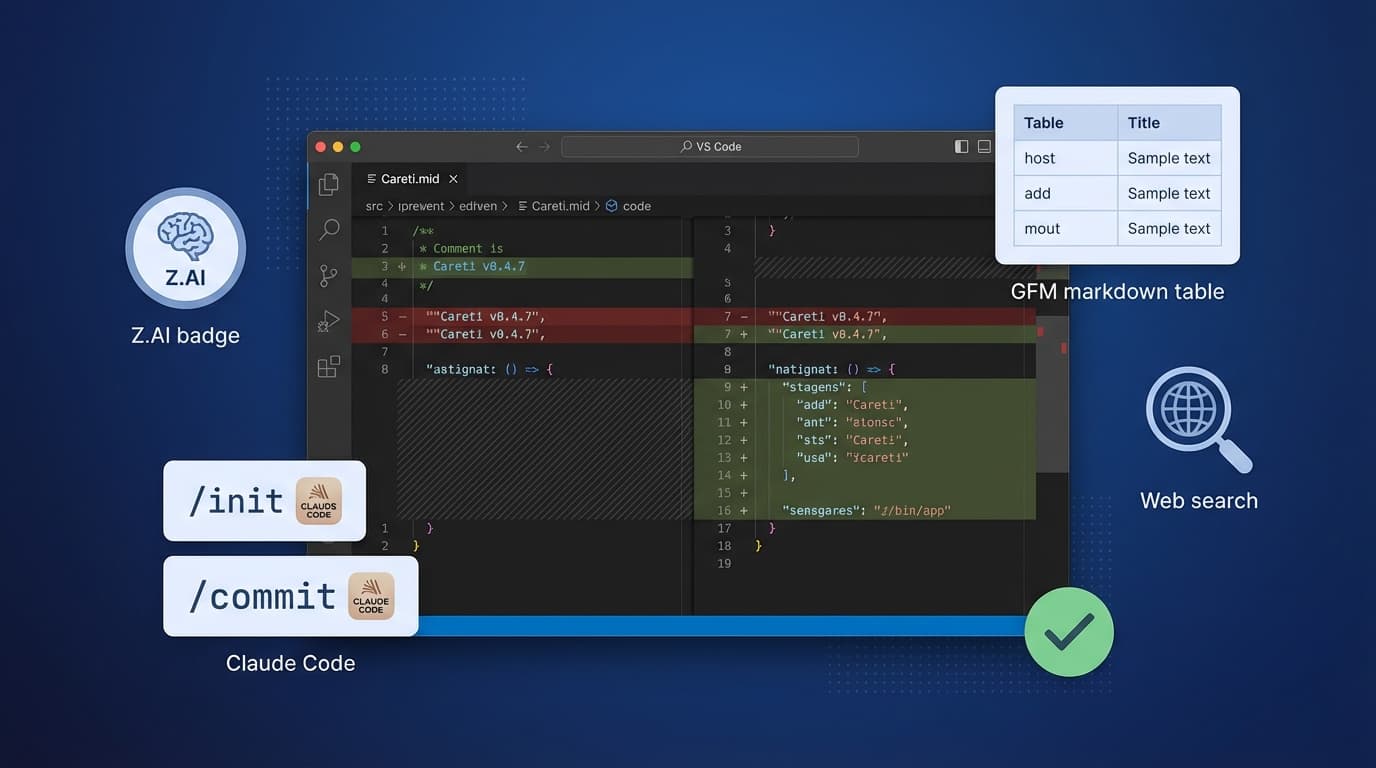

Careti v0.4.7 добавляет модель Z.AI GLM-4.7, систему команд, совместимую с Claude Code, улучшения SmartEditEngine и улучшения интерфейса.